GenAI գործիքների հեղափոխական տեխնոլոգիան՝ ChatGPT-ն, զգալի ռիսկեր է առաջացրել կազմակերպությունների կոնֆիդենցիալ տվյալների համար: Browser Security ընկերության կողմից իրականացրած նոր հետազոտությունը պարզաբանում է այս ռիսկերի բնույթի և մասշտաբների մասին:

«GenAI-ի տվյալների բացահայտման» վերնագրով զեկույցը կարևոր պատկերացումներ է ստեղծում տվյալների պաշտպանության կողմերի մասին և հնարավորություն է տալիս ձեռնարկել ակտիվ միջոցներ ռիսկերը կանխելու համար:

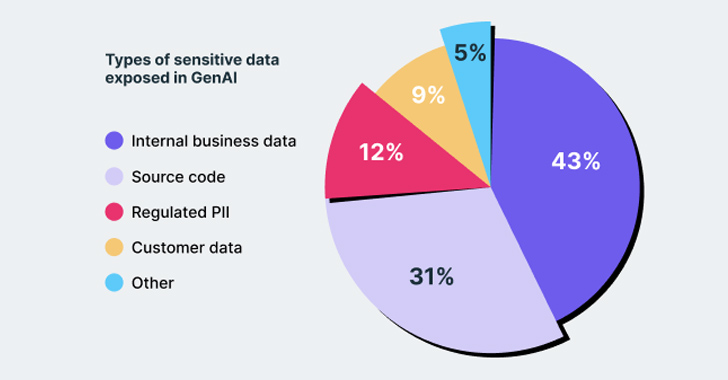

10 000 օգտատերերի շրջանում վերլուծելով ChatGPT-ի և արհեստական ինտելեկտի այլ հավելվածների օգտագործումը՝ զեկույցը հայտնաբերել է ռիսկային հիմնական ոլորտները: Կատարված բացահայտումը ցույց է տալիս, որ աշխատակիցների 6%-ը գաղտնի տվյալներ է տեղադրել GenAI-ում: Համանման գործողության պարբերաբար կրկնումը տվյալների արտահանման լուրջ վտանգ է առաջացնում:

Միայն վերջին երեք ամիսների ընթացքում GenAI-ի կիրառումն աճել է 44%-ով: Չնայած այս տենդենցին, կազմակերպության աշխատակիցների 19%-ը դեռևս շարունակում է կիրառել GenAI գործիքները: Այնումենայնիվ, GenAI-ի օգտագործման հետ կապված ռիսկերը մնում են հստակ և շոշափելի:

Հետազոտությունը ընդգծում է կոնֆիդենցիալ տվյալների բացահայտման արդիականությունն ու տարածումը։ GenAI-ից օգտվող աշխատակիցների 15%-ը իրականացրել է տվյալների տեղադրում, որոնցից 4%-ը՝ շաբաթական կտրվածքով, իսկ 0,7%-ը՝ շաբաթական մի քանի անգամ:

Ներկայիս նորարար տեխնոլոգիաների դարաշրջանում շատ կարևոր է ճիշտ գնահատել GenAI-ի օգտագործման մեխանիզմները և ունենալ անհրաժեշտ պատկերացում անվտանգության և տվյալների պաշտպանության հարցում: Հակառակ դեպքում, շահագրգիռ կողմերը պետք է պարբերաբար իրականացնեն ճիշտ մոնիտորինգ, ռիսկերի վերլուծություն և գնահատում՝ իրավիճակին արագ ու ճիշտ լուծում գտնելու համար:

Աղբյուրը՝ https://thehackernews.com/